B

Blue

2026年1月15日

Mini-Agent 框架简介

Mini-Agent 是由 MiniMax 开源的一个极简而专业的 AI Agent 开发框架,旨在展示使用 MiniMax M2.1 模型构建智能代理的最佳实践。与 LangChain 等复杂框架不同,Mini-Agent 采用轻量级设计,让开发者能够直达 Agent 的本质,理解其核心工作原理。核心特点

Mini-Agent 的设计理念是轻量(Lightweight)、简洁(Simple)、易扩展(Extensible)。它避免了过度封装,将 Agent 的核心逻辑清晰地展现在开发者面前,帮助学习者真正理解 Agent 是如何工作的,而不仅仅是学会如何使用某个框架的 API。重要功能

完整的 Agent 执行循环

完整的 Agent 执行循环

MiniAgent 实现了完整的 Agent 执行循环:感知→思考→行动→反馈。通过 LLM 进行决策,调用工具执行任务,并将执行结果反馈给 LLM,形成闭环的智能决策系统。

持久化记忆能力

持久化记忆能力

内置的 Session Note Tool 确保 Agent 能够在多个会话中保留关键信息,实现跨会话的记忆持久化,让 Agent 具备”记住”的能力。

智能上下文管理

智能上下文管理

采用自动摘要机制处理长对话场景,当上下文接近 Token 限制时,系统会自动调用 LLM 对历史对话进行压缩和摘要,从而支持无限长的任务执行。

丰富的工具生态

丰富的工具生态

- 基础工具集:文件读写、Shell 命令执行等基础能力

- Claude Skills 集成:内置 15 种专业技能,涵盖文档处理、设计、测试和开发等领域

- MCP 工具支持:原生支持 Model Context Protocol (MCP),可轻松接入知识图谱、网页搜索等外部工具

兼容多种 API

兼容多种 API

兼容 Anthropic 和 OpenAI 的 API 接口,支持不同模型厂家的 LLM API 接入。

Mini-Agent 架构

一个完整的系统由三个核心部分组成:LLM(大脑)- 负责理解与决策

LLMClientBase 是 LLM 的基类,定义了 LLM 的接口。在 Mini-Agent 项目中,基于 LLMClientBase 提供了 Anthropic 和 OpenAI 两种 LLM 的接入方式。

Tools(工具)- 执行具体任务的能力

- BashTool:执行 Shell 命令

- FileReadTool / FileWriteTool:文件读写

- SessionNoteTool:会话笔记(持久化记忆)

Memory(记忆)- 对话历史与上下文管理

Mini-Agent 循环机制

核心循环:感知→思考→行动→反馈 Mini-Agent 的核心执行逻辑在agent.py 的 run() 方法中:

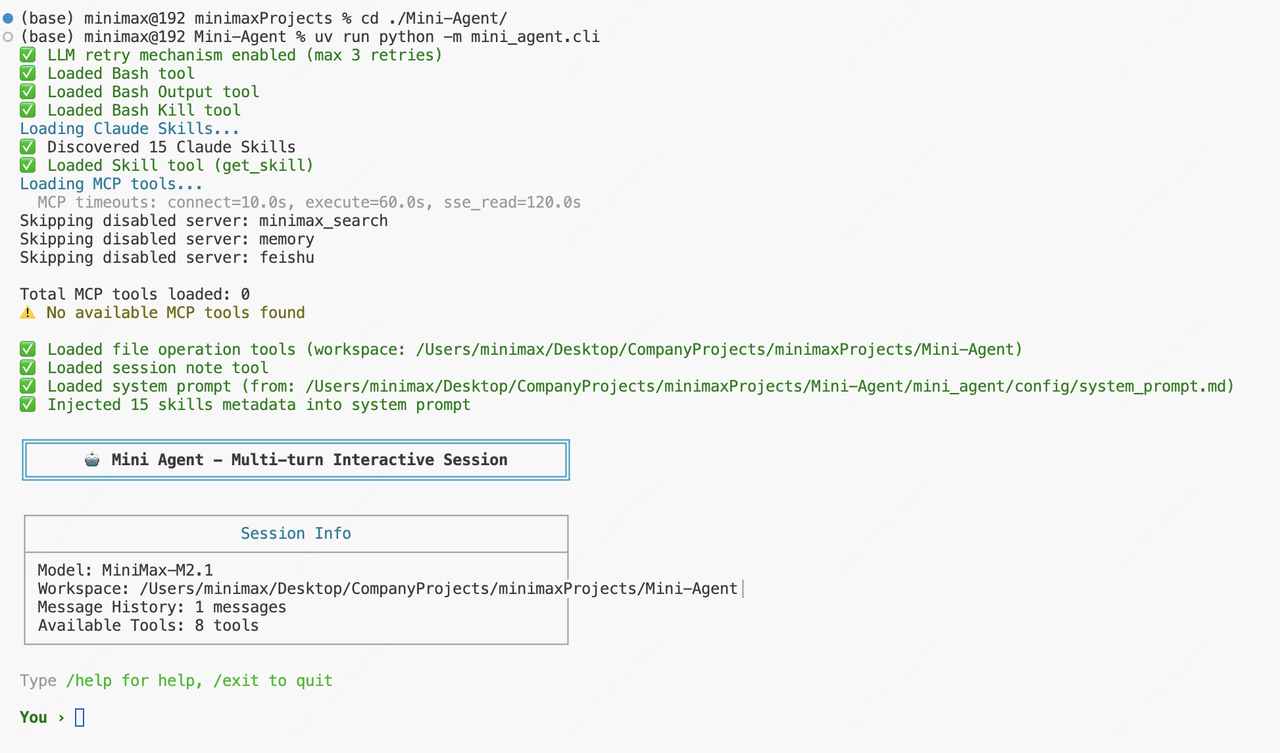

接入 MiniMax-M2.1

Step 1: 下载项目

Step 2: 配置文件

复制config-example.yaml 文件并重命名为 config.yaml

Step 3: 关键配置

Step 4: 其他配置(可选)

Step 5: 开始使用

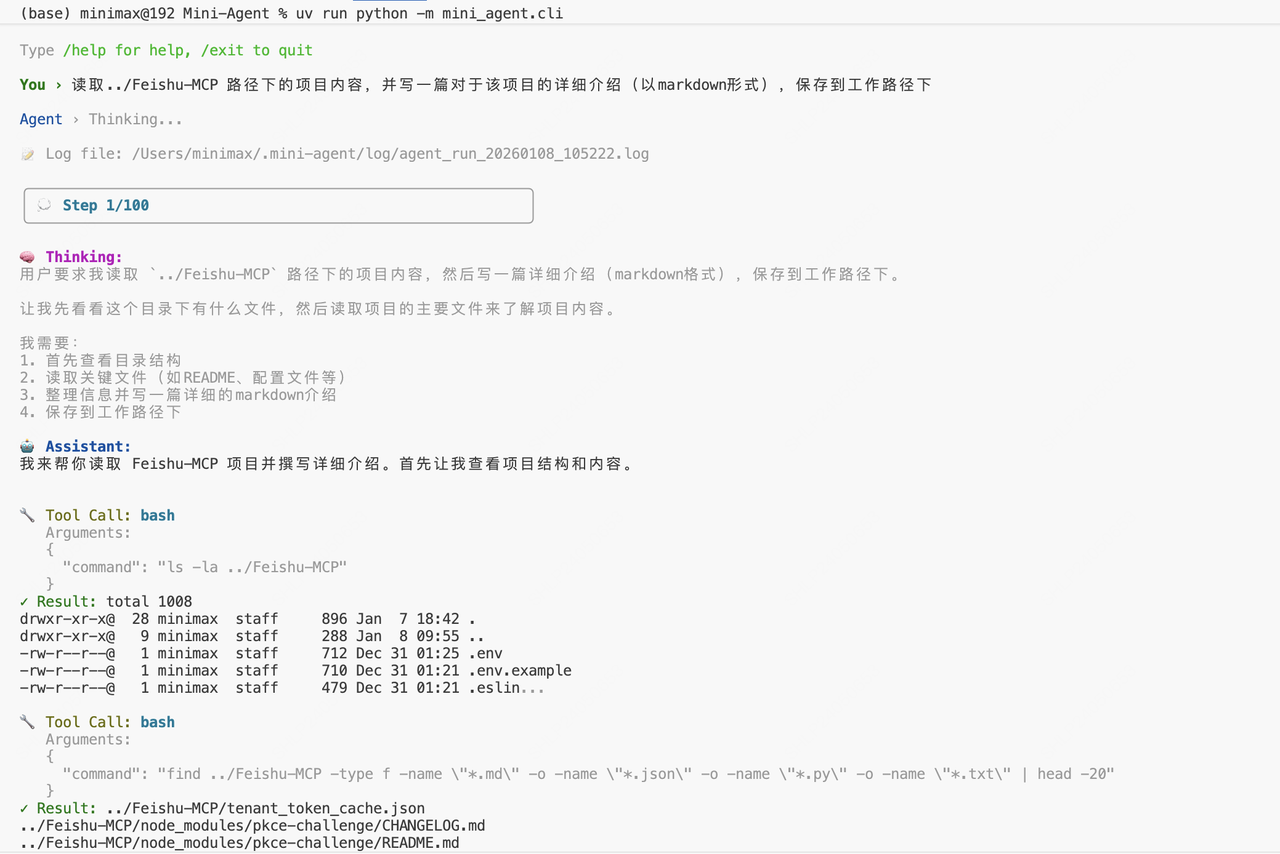

我们让它完成一项读取并解释 MCP 的任务:

我们让它完成一项读取并解释 MCP 的任务:

Mini-Agent 成功完成任务:

Mini-Agent 成功完成任务:

总结

- Agent 的本质是循环决策,包括感知(Perception)、思考(Thinking)、执行(Execution)、反馈(Feedback)四种类型的行为

- Memory 即 Agent 的记忆能力,本质是上下文(Context)的管理,包括对上下文的压缩、存储、检索等

- Tool 是 Agent 与外部系统交互、扩展能力的基础接口;而业界后续提出的 MCP、Claude Skills 等能力,可以看作是对 Tool 的进一步抽象

相关资源

MiniMax M2.1

详细介绍

Mini-Agent GitHub

框架源码与文档

MiniMax 开放平台

获取 API Key